A plataforma global de jogos Roblox implementou nesta semana uma atualização rigorosa em seus sistemas de comunicação para ampliar a proteção de menores. As novas diretrizes exigem que os usuários passem por reconhecimento facial para validar a idade e restringem o chat a interações entre faixas etárias semelhantes.

A mudança visa impedir que adultos estabeleçam contato direto com crianças e adolescentes dentro dos ambientes virtuais da ferramenta. Para jogadores menores de nove anos, o acesso às salas de conversa agora depende exclusivamente de uma autorização formal dos responsáveis.

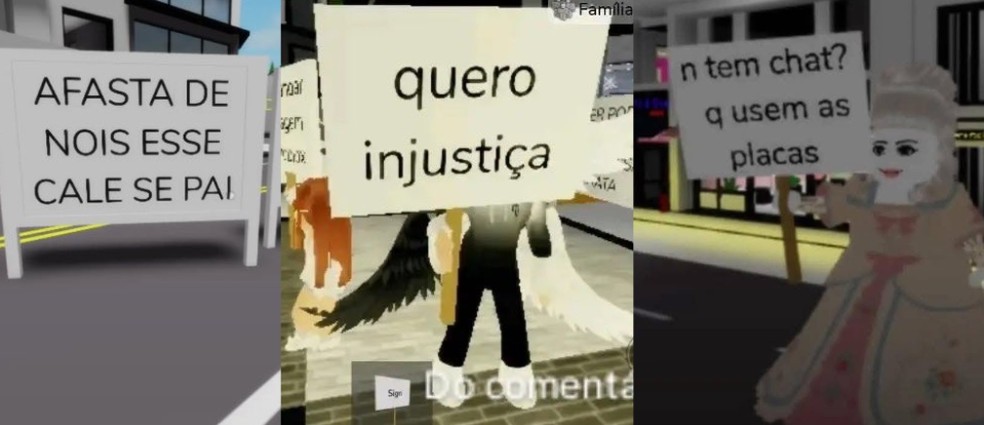

A medida gerou uma onda de manifestações digitais onde avatares utilizam cartazes e referências históricas para criticar as limitações. Relatos indicam que administradores da plataforma chegaram a sofrer ameaças diretas em meio ao descontentamento de parte dos usuários.

Essa não é a primeira vez que o ecossistema do jogo é transformado em palco para reivindicações sociais e protestos políticos. Movimentos semelhantes já ocorreram anteriormente nos Estados Unidos, simulando manifestações reais contra órgãos de imigração dentro do servidor.

O endurecimento das regras responde a uma série de pressões judiciais e críticas sobre a vulnerabilidade de crianças a predadores sexuais no site. Em estados americanos, o Roblox enfrenta processos que acusam o sistema de falhar na vigilância contra usuários mal-intencionados.

A empresa assegura que os dados biométricos coletados durante a verificação são descartados imediatamente após a análise de segurança. O procedimento faz parte de um novo pacote tecnológico que inclui filtros automáticos e monitoramento contínuo das atividades globais.

Leia também:

Deixe um comentário